智能夜巡机器人

作品简介

“智护夜巡”机器人融合红外-LiDAR-SLAM、大模型语音交互与GPU加速,实现夜间无光环境下的自主导航、避障、查房与情感对话,低本高效,直击老龄化护理痛点。

|

一、作品拟解决的工程问题 本项目聚焦于当前老年护理行业所面临的关键工程挑战,旨在开发一款具备自主感知、智能交互与安全操作能力的智能护理机器人,以提升夜间照护效率、增强老年人生活质量,并缓解护理人员的人力压力。项目拟解决的主要工程问题包括以下五个方面: 1. 低光环境下的自主导航与定位问题 针对夜间照护场景中光照不足导致的导航失效问题,项目采用红外相机与激光雷达(LiDAR)融合感知技术,结合SLAM(同步定位与建图)算法实现环境建图与自主定位。该组合方案可在无光或弱光环境下持续工作,保障机器人在老年人居住空间中的可靠路径规划与动态导航能力。 2. 动态环境中的障碍物避让问题 考虑到养老场所中人员移动频繁、家具位置可变,机器人需要具备避障能力以保障运行安全。本项目规划集成多传感器融合系统(红外、LiDAR、深度相机)及动态避障算法(如人工势场法、DWA算法),实现对移动障碍物的实时感知与路径动态调整。 3.高效的语音交互与对话辅助问题 4. 多任务协同与数据管理问题 为满足导航、语音、手臂控制等任务的实时并行处理需求,系统在计算架构上采用GPU加速机制,将计算密集型模块(如语音与大模型推理)卸载至GPU执行,实现多线程并行调度与性能优化;同时,借助MySQL数据库系统实现任务状态、用户信息、环境地图等数据的统一管理,增强系统的数据一致性与响应效率。 工程要素整合分析 技术性要素:涵盖SLAM定位建图、传感器融合、路径规划与避障、自然语言处理、数据库管理、GPU加速等多个机器人核心技术模块,体现了“感知-决策-执行-交互”一体化的工程架构; 非技术性要素:在用户体验(老年人友好交互)、伦理隐私(数据合规管理)、使用安全(物理防护机制)、成本控制(软硬件选型)、系统可扩展性(模块化架构)等方面均进行了充分考虑与系统规划,展示出成熟的工程实践能力与应用落地视角。 |

|

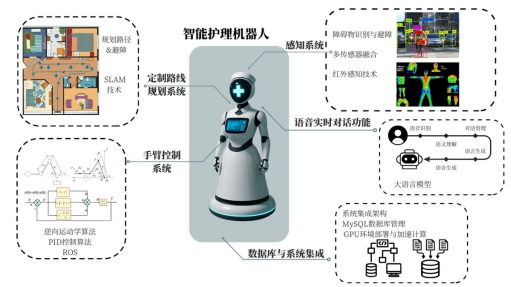

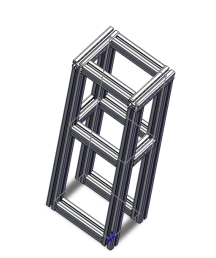

二、作品概况 图1 护理机器人的功能一览 1. 设计目标 本作品旨在开发一款面向老年人照护场景的智能护理机器人,通过集成环境感知、语音交互、机械操作与任务协同等多项关键技术,实现夜间查房、递药扶持、语音求助等功能,提升老年人生活便利性与护理安全性,减轻医护人员工作负担。 2. 设计实施方案 机器人整体架构采用模块化设计,主要包括以下几个功能子系统: 导航定位系统:结合MID360激光雷达与奥比中光深度相机,通过FAST-LIO激光惯导定位算法实现高精度自主定位,同时采用ConceptGraph建图算法进行室内空间拓扑建图,保障机器人在室内环境中的实时路径规划与导航能力。 动态避障系统:基于多传感器融合(红外、深度相机、LiDAR)与动态避障算法(如人工势场法),实现机器人在复杂、变化环境中的自主避障与路径调整; 语音交互系统:语音识别与语音合成模块,并嵌入大语言模型,支持自然语言指令解析与应急语音求助; 数据管理与任务调度系统:通过MySQL数据库进行信息存储与统一管理,利用GPU资源支持语音与任务模块的高效并行处理。 机器人整机形态与结构设计: 机器人底盘采用RANGER MINI 2.0智能移动底盘,具备稳定的驱动能力与良好的环境适应性; 控制与计算模块基于NUC迷你主机,提供稳定计算平台; 电源模块选用大功率充电宝,确保长时间续航; 上层结构为3D打印定制外壳,结合人机交互需求进行形态优化,提供设备保护与美观设计; 所有核心部件均运行于ROS(Robot Operating System)平台,便于各模块之间的信息通信与统一调度,具备良好的可扩展性与二次开发能力。 3. 当前完成度 目前已完成以下主要功能模块的开发与测试: SLAM自主导航与定位系统;多传感器融合下的动态避障模块;语音识别、语音合成与对话控制模块;机器人整机形态与结构设计;数据库管理与多任务并行处理系统。 机器人已初步完成联调,并具备在室内老年护理场景中运行的基本能力。 4. 预期最终成果 最终作品将呈现一款具备自主移动、动态避障、语音交互、物理交互与任务协同能力的智能护理机器人,能够适应夜间及动态环境的护理需求,支持日常服务与紧急响应,具有良好的系统扩展性和实际应用价值。

|

|

三、团队合作 在本项目中,我们团队采取了高度协同与整合的工作模式。每一位成员在项目中都各司其职,又相互支撑,通过紧密的沟通与交叉协作,共同克服了从理论设计到物理实现过程中的各项工程挑战。

阮建豪(团队负责人 & 语音交互模块开发):作为团队负责人,负责统筹项目的整体规划与进度把控,确保各个模块的开发能够协调同步,并积极与校内导师及相关负责人沟通,争取资源与支持。在技术层面,独立主导了机器人语音交互核心模块的开发工作,完成了从技术选型(faster-whisper、edge-tts)到本地化大语言模型部署的全过程,并设计了直观易用的语音交互UI界面。该模块不仅是机器人的“耳朵”和“嘴巴”,更是整合所有底层功能的总入口,为用户提供了便捷的控制方式。

赵一帆(SLAM定位与建图模块开发):主导了机器人“空间认知能力”核心——SLAM定位与建图模块的开发。负责设计整个SLAM系统架构,并解决了多传感器数据融合的关键技术难题。开发了地图构建模块,特别针对夜间感知能力进行了增强,确保了机器人在低光环境下的定位精度和建图稳定性。与徐文瀚紧密合作,利用其处理后的多源数据实现了准确定位;同时,设计了协同接口,为路径规划模块提供了精确的位姿和地图信息,是机器人自主导航的基石。

陈泳如(机器人外形设计与制作):负责将团队的功能构想转化为物理实体,承担了机器人完整的外形设计与制作工作。运用SolidWorks等专业工具进行精细的3D建模,巧妙地在满足内部硬件(如传感器、主板)安装需求的同时,兼顾了机器人的整体美学与亲和力。在制作过程中,与负责硬件搭建的徐文瀚反复沟通,确保每一个结构设计都能精准容纳并保护内部的精密元器件,为机器人打造了一个既坚固又灵巧的“身躯”。

吴咏珊(数据库、系统集成与报警功能):作为整个系统后台的“架构师”,负责数据库管理、系统集成及核心的报警功能;设计并维护了MySQL数据库,确保了机器人所有运行数据(如定位、任务、传感器信息)的安全、完整与实时存储。在系统集成方面,搭建了各模块间的数据桥梁,确保了语音、导航、感知等模块的数据能够顺畅交互。此外,独立开发了报警功能,能够有效接收并处理前端的异常检测信号,并及时将报警信息发送至护士站,完成了从“感知”到“行动”的关键闭环。

徐文瀚(硬件搭建与多模态感知系统开发):负责构建机器人的“感知神经系统”。不仅完成了所有硬件的选型与搭建,还主导了融合红外信息的感知与避障算法的开发。应用YOLO算法优化了红外图像中的目标检测,并开发了一整套热图降噪与特征提取流程,极大地提升了机器人在夜间或无光环境下的定位与避障能力。完成了激光雷达、深度相机、红外相机的多传感器数据同步、配准与融合工作,为赵一帆的SLAM模块提供了高质量、多模态的数据源,是整个系统能够在复杂环境下稳定运行的关键保障。

|

|

四、作品设计技术报告 1.导航与定位系统

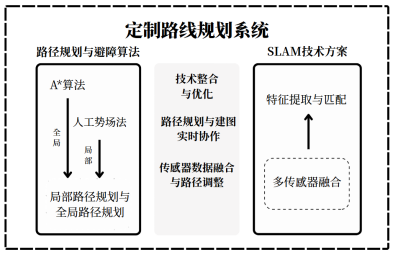

图2 定制路线规划系统流程图 1.1 工程问题与解决目标 在夜间巡房、低照度环境或烟雾弥漫等复杂条件下,传统的基于RGB摄像头的视觉SLAM(同步定位与建图)方案常因光照变化敏感而面临挑战,具体表现为定位不稳定、有效特征提取困难,并最终导致建图精度显著下降。为克服这些局限,本项目在导航与定位系统的设计中,明确了四大核心目标:首先,实现机器人在无光或弱光环境下的高精度定位与稳定建图能力;其次,保证系统在面对行人等动态障碍物时,依然能够进行鲁棒的自主导航;再次,构建一张融合热辐射信息与三维几何信息的“多模态环境地图”,以支持更高效的路径规划与动态避障策略;最后,确保整个系统能够在室内医疗等要求严苛的场景中长期稳定运行,并具备自动完成地图闭环修正的能力。 1.2 技术路线与核心方法 为实现上述目标,本导航定位系统采纳了“多传感器协同 + 激光惯导SLAM + 热图特征增强”的总体技术架构。该架构集成了多项关键技术路径以确保系统的性能与稳定性。在传感器融合层面,系统协同利用了MID360激光雷达(提供主视角的高精度空间测距)、奥比中光深度相机(用于三维环境结构的精细感知)以及红外相机(实现夜间或复杂环境下的热成像)共同采集环境信息,形成了优势互补的多源感知能力。在核心SLAM算法上,本系统基于业界前沿的FAST-LIO框架,该框架通过紧耦合的方式融合了LiDAR与IMU(惯性测量单元)数据,从而实现了高频率、低漂移的室内定位与里程计估计。在地图构建策略上,系统创新性地引入了ConceptGraph拓扑建图算法,用于构建环境的高层次结构化信息(如走廊、房间),同时结合一个专门的热图像处理模块,生成一张包含几何与热力学特征的多模态地图,极大地丰富了地图信息维度。在运行平台方面,所有模块均在ROS(机器人操作系统)中高效运行,其中,底层的传感器驱动与核心SLAM算法使用C++实现以保证极致性能,而上层的数据分析与系统监控则采用Python实现,以兼顾开发效率与灵活性。 1.3 系统设计流程与模块构成 本系统的设计与实现遵循了严谨的工程流程,共分为六个关键环节。第一步是传感器选型与标定,我们精心挑选并完成了红外相机、激光雷达与深度相机之间的时序对齐与空间坐标系的精确标定,为后续数据融合奠定了坚实基础。第二步是核心算法部署,我们成功部署了FAST-LIO算法,构建了IMU与激光点云数据紧耦合的位姿估计模块,为系统提供了高精度的实时定位。第三步是热图辅助建图,我们独立开发了包含图像降噪、热边缘提取和温差增强等功能的热图处理程序,能够从热图像中提取稳定的环境特征,用以辅助和增强SLAM的建图效果。第四步是拓扑地图构建,利用ConceptGraph算法,我们将物理空间中的走廊、房间等关键区域抽象为拓扑图中的“节点”,并以“边”来表示它们之间的连通关系,形成了一张更符合人类认知和高级导航任务的地图。第五步是系统集成,我们将SLAM模块、热图处理模块、地图构建模块以及路径规划功能在ROS系统中进行了全面集成,打通了完整的数据流与控制链路。第六步是测试与优化,通过在真实场景中的大量实地测试,我们对系统的地图构建速度、定位精度和长期运行的鲁棒性进行了系统性评估,并依据结果对传感器权重、算法参数等系统设置进行了精细化迭代优化。 1.4 工程工具与平台选型原则 本模块所采用的关键工具与平台的选型,均遵循了开源可控、性能稳定、支持高并发、易于集成以及拥有活跃社区支持的原则,以确保开发效率与系统可靠性。具体而言,SLAM系统选用FAST-LIO,因其对多种LiDAR设备具有良好的兼容性,并能与IMU实现紧耦合,提供了高频更新和低延迟的位姿估计,完美契合室内医疗场景对稳定性的高要求。地图构建则采用ConceptGraph方法,该方法能将病房、通道等结构化空间抽象为拓扑图,更适合执行语义级别的导航任务。热图像处理利用了功能强大的OpenCV框架,高效实现了温差增强、边缘提取与图像配准等关键功能。此外,点云处理采用业界标准的PCL(Point Cloud Library),而异步数据融合则通过卡曼滤波器进行处理。整个系统平台统一构建在ROS(Robot Operating System)架构之下,其优异的模块解耦性和高效的消息传递机制为系统的开发与维护提供了巨大便利。

1.5 模块协同机制与数据交互 导航模块作为系统的核心组件之一,依托ROS强大的通信机制,与系统中其他子模块建立了高效的协同工作流程。具体来说,SLAM模块作为数据源,持续通过ROS话题(Topic)发布机器人的实时位姿信息(pose)和地图信息(map, odom)。路径规划模块订阅这些信息,结合预设的目标点,生成全局导航路径。同时,避障模块实时监听来自激光雷达(laser_scan)和热图处理模块的传感器话题,用于动态调整局部路径以规避突发障碍。此外,语音交互模块可以通过解析用户命令,触发“导航到目标点”或“回到起始点”等具体的导航行为。最后,任务调度中心则负责监控整体导航状态和路径完成情况,并据此动态分配任务流。通过灵活运用ROS中的话题(topic)、服务(service)与动作(action)三种通信机制,各模块实现了异步通信、数据共享与状态反馈,运行时互不阻塞,做到了真正的解耦运行,这极大地提升了系统的整体响应效率与多任务处理的稳定性。 1.6 实验设计与数据评估方法 为科学、严谨地评估导航定位系统的性能,我们设计了围绕定位精度、建图效率和长期稳定性三个维度的实验。在定位精度测试中,我们在一个10×10米的标准化测试区域内预设了参考轨迹点,通过测量SLAM估计路径与真实路径的偏差来评估平均误差与最大误差,目标是将平均误差控制在5厘米以内,最大误差不超过12厘米。在建图速度与完整性测试中,系统在典型室内环境中从初始状态开始构建完整地图,我们测量其地图收敛时间和墙面结构拟合误差,期望在25秒内完成建图,且几何误差不超过8厘米。在SLAM闭环检测能力测试中,我们通过模拟巡逻场景,让机器人多次重复相同路径,记录回环检测的成功率与轨迹漂移的修正效果,期望成功率高于90%,漂移修正幅度在30%以上。所有实验数据均通过Python及其Pandas、Matplotlib等科学计算库进行自动化采集、统计与可视化分析,最终输出的误差曲线图、性能对比图与误差柱状图,为系统优化提供了强有力的数据支撑和决策依据。 2. 机器人外形制作方案 2.1 工程问题分析 机器人的外形设计需兼顾功能性与结构强度。具体而言,机器人需具备灵活的运动能力。其头部结构必须能够容纳并稳固安装内部的各类传感器、摄像头等精密设备。身体部分作为核心承载区,需要为控制主板、电源等核心部件提供充足的空间和可靠的物理防护,因此必须具备足够的结构强度。同时,海绵手臂的设计要求柔软且能灵活配合手部执行动作。最后,锡纸人架作为整体造型的基础,主要起到支撑与塑造外形轮廓的作用,其结构必须满足整体设计的形态要求。 2.2 技术路线 为实现上述设计目标,我们制定了包含六个阶段的系统性技术路线。首先进行前期调研,广泛收集同类机器人的外形设计资料,深入研究3D打印、铝型材搭建技术及特殊材料的应用工艺。随后进入方案设计阶段,依据详细的技术指标要求,分别对机器人头部、手部、肩部、身体、海绵手臂和锡纸人架进行结构与造型设计。接下来是模型制作,利用3D建模软件完成所有打印部件的精细模型设计并进行打印,同时依据设计图纸对4040铝型材进行切割搭建,并同步制作海绵手臂与锡纸人架。之后,我们对所有部件进行严格测试,包括3D打印件的精度与强度、铝型材身体的稳定性以及手臂和人架的功能性测试。根据测试结果,我们进行优化改进,针对性地调整设计方案和制作工艺。最后,在组装调试阶段,将所有优化后的部件进行最终组装,并对各部件之间的配合进行细致调试,确保机器人整体性能完全满足设计要求。 2.3 作品设计流程 2.3.1 需求分析 项目初期,我们与团队进行了深入沟通,全面明确了机器人的核心功能、目标应用场景及关键性能要求,并在此基础上将这些需求转化为外形设计的具体目标与可量化的技术指标。 2.3.2 概念设计 在需求分析的指导下,我们展开了机器人外形的创意构思,绘制了多版初步的外形草图。通过比较和筛选,我们最终确定了机器人的整体造型风格以及各个核心部件的大致结构布局。

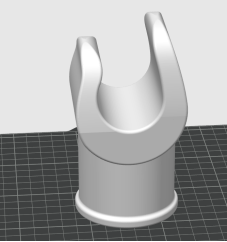

图3 机器人的手

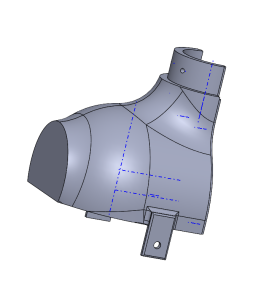

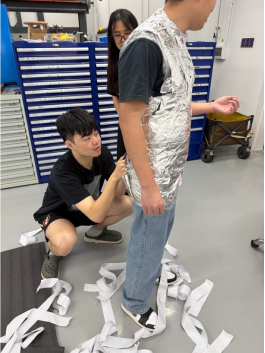

图4 机器人的肩膀 图5 机器人的内部支架

2.3.3 详细设计 在详细设计阶段,我们对每个部件都进行了精确的规划。我们使用专业3D建模软件(SolidWorks)对头部、手部和肩部进行三维建模,在设计过程中精确规划了内部的安装结构和外部的曲面形状,以确保其既满足功能需求,又具备美学考量。根据机器人内部设备的布局和整体尺寸规划,我们为4040铝型材身体设计了详细的搭建方案,精确定义了每根型材的规格、长度和连接方式,以构建稳固的机身框架。同时,我们精心设计了海绵手臂的外部形状、尺寸以及内部的骨架结构,并明确了其与手部、肩部的连接方案,从而保证其运动的灵活性和结构的耐久性。最后,我们设计了锡纸人架的基础造型和核心支撑结构,并充分考虑了其与其他部件的配合关系,以确保其能够完美融入整体设计。

图6 给机器人设计倒模 2.3.4 模型制作与加工 在模型制作与加工环节,我们严格按照设计方案执行。我们将经过验证的3D模型文件导入拓竹系列3D打印机,设定优化后的打印参数,高精度地制作出头部、手部和肩部等复杂部件。同时,我们严格按照设计方案对4040铝型材进行精确切割,并使用标准连接件进行搭建,最终组装成坚固的机器人身体框架。我们还裁剪了合适尺寸的高密度海绵,植入内部骨架,塑造出手臂的形态,并完成了与手、肩连接部件的制作。我们首先制作了泡沫基础模型作为骨架,然后将锡纸仔细包裹并固定在泡沫上,最终完成了具有金属质感的锡纸人架。 2.3.5 部件测试 所有部件制作完成后,我们进行了全面的测试。我们使用游标卡尺等精密测量工具检验了3D打印部件的尺寸精度,并通过施加预定压力的方式测试了其结构强度。对于搭建完成的身体结构,我们进行了严格的稳定性测试,通过模拟机器人在运动状态下的受力情况,检查是否存在晃动或永久变形。此外,我们还测试了海绵手臂的运动灵活性及其与其他部件的配合顺畅度,并检验了锡纸人架的支撑强度和造型稳定性。 2.3.6 优化改进 根据部件测试阶段发现的问题,我们对不符合要求的部件进行了针对性的优化。例如,调整3D打印模型的内部结构或打印参数以增强强度,改进铝型材的连接方式以提升稳定性,以及优化海绵手臂和锡纸人架的设计以改善其功能表现。

图7 机器人的初步框架 2.3.7 组装调试 在所有部件通过测试和优化后,我们进行了最终的整机组装,确保所有连接都牢固可靠。随后,我们对机器人外形各可动部分之间的配合进行了细致调试,检查运动是否顺畅无干涉,并确保整体外观与最终设计要求一致。

图8 机器人最终形态 2.4 采用的现代工程工具和信息技术工具 2.4.1 3D建模软件 (SolidWorks) 我们选择SolidWorks作为核心3D建模软件,主要基于其在机械设计领域的专业性与设计效率。该软件强大的参数化设计功能,允许我们在机器人头部、手部及肩部的建模过程中,通过简单修改参数便能快速调整模型尺寸与内部结构,极大地提升了迭代设计的效率。例如,在设计肩部球形关节时,我们能够精准设定关节的直径、活动角度等关键参数,并实时预览模型变化,确保了设计的精确性。此外,SolidWorks卓越的装配体设计模块使我们能够预先在虚拟环境中模拟各部件的装配关系,从而提前发现潜在的尺寸不匹配或运动干涉问题,保证了3D打印部件与4040铝型材框架、海绵手臂等不同材质部件的精准配合,为后续的实体制作奠定了坚实基础。 2.4.2 3D打印机 (拓竹系列) 拓竹系列3D打印机凭借其出色的打印精度和运行稳定性,成为本次机器人外形部件制作的理想选择。该系列打印机支持包括高强度ABS、尼龙在内的多种工程材料,能够充分满足机器人不同部件对材料强度、韧性等方面的差异化要求。在打印精度方面,它能够将误差控制在微米级别,确保了头部、手部、肩部等关键连接件的尺寸精度,使其能与铝型材框架及其他部件完美适配。同时,拓竹3D打印机具备的高效打印速度和稳定的打印流程,有效缩短了制作周期,减少了因打印失败造成的时间与材料浪费。其配套软件的友好交互界面,也使得打印参数设置、模型切片等操作变得简单直观。 2.4.3 测量工具 为精准把控机器人各部件的尺寸精度,我们采用了游标卡尺、角度尺等高精度测量工具。在3D打印部件的质检环节,游标卡尺能够精确测量部件的长度、内外径等关键尺寸,将测量误差控制在极小范围内,确保了打印成品与设计图纸的高度一致。对于4040铝型材的切割与组装过程,角度尺则用于准确测量型材的切割角度,保证了铝型材框架的角度精确性,从而使整个机身结构更加稳固。这些测量工具的应用,为整个机器人外形制作过程中的尺寸控制提供了可靠保障,是确保各部件能够精准配合的关键。 3. 融合红外感知的环境感知与避障模块

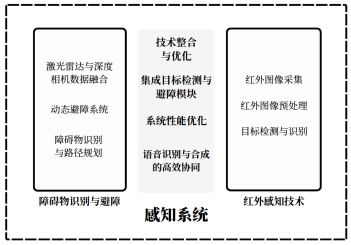

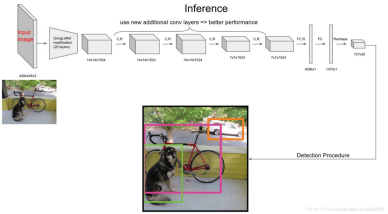

图9 感知系统概念图 3.1 工程问题与解决目标 在智能护理等应用场景中,机器人必须具备全天候的环境感知能力,尤其是在夜间或低光照等传统视觉传感器性能下降的复杂环境中,能够实时、准确地识别环境中的人体、障碍物等关键目标。本模块的核心目标正是为了解决传统视觉传感器在低光照条件下近乎失效的痛点,为机器人提供一套可靠的环境感知解决方案,从而实现安全、自主的导航与障碍物规避功能。 3.2 技术路线与核心方法 为应对上述挑战,本模块采用了以红外感知为核心,并深度融合多种传感器信息的技术路线。核心感知技术是采用高分辨率红外相机捕捉环境的热量分布,从而在低光环境中有效识别出具有体温的人体等热源目标。在目标检测算法上,我们集成了基于深度学习的YOLO系列算法以满足高实时性需求,或Faster R-CNN算法以实现更高的识别精度。为了获得目标的完整空间信息,我们通过多传感器融合策略,将红外图像的二维目标信息与激光雷达(LIDAR)和深度相机提供的三维空间点云数据进行深度融合,极大地提高了障碍物识别的精度与可靠性。最后,采用如人工势场法等动态避障算法,使机器人能够根据实时感知的障碍物信息,快速响应并平滑地调整行进路径。 3.3 系统设计流程与模块构成 本模块的系统流程设计精密,主要由图像采集、数据处理、目标检测与数据融合四个核心环节构成。首先,通过红外相机进行红外图像采集与预处理,对实时采集的热辐射图像进行去噪和对比度增强,以提升图像质量并突出目标特征。随后,将预处理后的图像输入到预先训练好的深度学习模型(如YOLO或Faster R-CNN)中进行目标检测与识别,实时输出图像中目标的类别与位置信息。接下来,系统进行多模态数据融合,将来自红外图像的二维目标检测结果,与激光雷达、深度相机同步提供的三维点云数据进行空间和时间上的对齐与融合,构建出一个包含目标精确三维空间位置的、更为全面的环境模型。最后,整个感知与避障模块被封装为一个独立的、功能完整的节点,并通过系统集成到机器人操作系统(ROS)中,为上层应用提供稳定、可靠的环境感知服务。 图10 YOLO算法概念图 3.4 工程工具与平台选型原则 我们的选型原则旨在确保系统的可靠性与实时性。我们选用如FLIR Lepton、Optris等品牌的高分辨率红外相机,以保证在夜间或低光环境下获取清晰的热图像。在深度学习算法方面,我们灵活选用YOLO系列以追求卓越的实时性能,或选用Faster R-CNN以在复杂环境中获得更高的检测精度。为确保深度学习模型推理的实时性,我们采用GPU等硬件加速平台进行密集型计算,满足机器人对环境变化的快速响应需求。最后,我们选用ROS(机器人操作系统)作为统一的开发与集成框架,其模块化设计和高效的通信机制极大地简化了本感知模块与导航、控制等其他模块的集成与协同工作。 3.5 模块协同机制与数据交互 在ROS框架下,本感知模块作为一个关键的数据生产者节点,与其他模块实现了高效协同。感知模块将检测到的障碍物信息,包括其类别、置信度、三维空间位置等,通过ROS消息机制发布到一个专有的话题(Topic)上。作为订阅者,路径规划模块实时监听该话题,一旦接收到新的障碍物数据,便会立即将其纳入考量,并据此实时调整机器人的全局及局部行进路径,从而实现动态、安全、高效的避障功能。 4. 智能语音交互系统

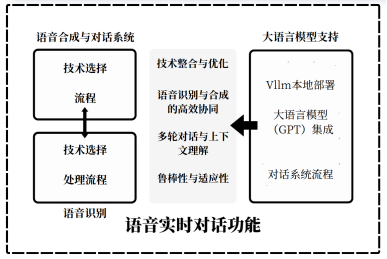

图11 语音实时对话功能概念图

4.1 语音识别 (Speech Recognition) 语音识别模块是人机交互的入口,其核心任务是将用户的语音指令实时、准确地转化为文本。 4.1.1 语音识别技术选型 在技术选型上,本系统采用了性能卓越的faster_whisper库,并具体指定了其强大的large-v3模型。为实现高性价比的本地化部署,该模型被配置在CPU上以int8量化类型运行。这一选择实现了业界顶尖的语音识别准确率与硬件成本的完美平衡,尤其擅长处理现实世界中常见的口音和背景噪声。通过int8量化技术,模型无需昂贵的GPU即可在机器人本体上高效运行。此外,该方案原生支持多语言识别,我们在代码中也已明确实现了对粤语(yue)、普通话(zh)和英语(en)的精准识别能力。 4.1.2 语音识别处理流程 语音识别的完整流程由用户在图形界面的交互触发。当用户点击“开始录音”按钮时,系统会启动一个独立的后台线程来调用pyaudio库进行录音,从而确保主界面的流畅响应。录音过程以16000Hz的采样率和16-bit的位深度进行,采集一段固定时长(7秒)的音频流。录音结束后,采集到的音频帧被整合并保存为一个临时的temp.wav文件。最后,faster_whisper模型加载此音频文件,根据用户当前选择的语言进行精准转写。识别出的文本最终通过线程安全的消息队列传递给主线程,以进行后续的智能处理。 4.2 语音合成 (Speech Synthesis) 语音合成模块的功能是将大语言模型生成的文本回复,以自然、清晰的语音形式播放给用户,完成交互闭环。 4.2.1 语音合成技术选型 为了实现高质量、拟人化的语音输出,系统集成了edge-tts库。该技术方案的背后是Microsoft Edge浏览器所使用的强大云端语音合成服务。选择edge-tts的核心优势在于,它能够生成多种听感自然且富含情感的AI语音,例如我们在代码中为普通话指定的zh-CN-XiaoxiaoNeural音色。此外,这项服务响应速度快且免费,对于需要频繁进行语音反馈的机器人应用场景而言,是一个极具性价比的理想选择。 4.2.2 语音合成流程 语音合成流程在系统生成文本回复后被立即触发。首先,由AI生成的文本回复被捕获,并传递给一个异步处理函数。该函数随后启动edge_tts.Communicate服务,将文本内容连同预设的语言及语音模型(如用于粤语的zh-HK-HiuGaaiNeural)作为参数提交处理。云端服务在完成语音合成后,将音频数据流返回,系统将其保存为一个output.wav文件,并立即通过系统命令(如在macOS下使用afplay)进行播放,使用户能够即时听到机器人的语音回应。 4.3 大语言模型支持 (Large Language Model Support) 大语言模型是机器人的“大脑”,负责深度理解用户意图并生成智能、连贯且符合其角色设定的回复。为确保回复的专业性与准确性,系统采用了先进的检索增强生成(RAG)架构。 4.3.1 大语言模型集成 系统的核心智能源于本地化部署的Qwen/Qwen3-8B大语言模型。我们通过一个本地HTTP API端点与该模型进行交互,这一方案完全摆脱了对外部云端服务的依赖,从而有力地保障了数据隐私和离线运行能力。更重要的是,为了大幅提升其在特定领域的专业性,该模型的能力通过一个本地的、领域特定的知识库进行了实时增强。这种设计使得机器人不仅能进行流畅的通用对话,还能提供基于预设知识库的、精准可靠的专业信息。 4.3.2 对话系统流程 对话系统的流程经过精心设计,以支持完整的检索增强生成(RAG)管线。当接收到用户的提问后,系统并非直接将其抛给大模型。第一步,用户的提问会通过sentence-transformer模型被转化为一个高维向量。第二步,系统使用这个向量在本地的ChromaDB向量数据库中进行相似度查询,以检索出与问题最相关的知识片段。第三步,这些检索到的专业知识将与原始问题、完整的对话历史以及预设的系统角色提示(System Prompt)进行动态整合,形成一个内容更丰富、信息更聚焦的“增强提示词”。最后,这个增强后的提示词才被发送给本地的Qwen模型。模型基于这些精准的上下文信息生成最终回应,从而极大地确保了回答的准确性和专业性。 4.4 技术整合与优化 系统的稳定性和卓越的用户体验,依赖于各技术模块之间的高效协同。 4.4.1 高效协同与响应式UI 为实现高效协同并打造无卡顿的响应式用户界面,系统全面采用了多线程架构。所有可能耗时的操作,如录音、知识库检索以及调用大语言模型,均被置于独立的后台线程中执行。主线程则专职负责UI界面的更新和用户交互的即时响应。线程之间通过Python内置的queue.Queue这一线程安全的消息队列进行通信,确保了数据传递的同步与安全,从根本上避免了因等待耗时操作而导致的界面“假死”或冻结问题。 4.4.2 多轮对话与上下文管理 在上下文管理方面,系统通过一个名为conversation_history的Python列表来动态维护和追踪多轮对话的历史记录。通过设定max_history_length这一可配置参数,系统能够有效地控制上下文窗口的长度。这种机制既保留了足够多的历史信息以保证对话的逻辑连贯性,又避免了因上下文过长而可能导致的模型响应速度下降或资源消耗过多的问题。 4.4.3 本地知识库与检索增强 本系统的核心竞争优势之一,在于其强大的本地知识库与检索增强(RAG)能力。该功能基于ChromaDB向量数据库实现,用于存储专业的医疗建议、护理知识等结构化信息。在系统启动时,这些知识文档会通过sentence-transformer模型被预处理成向量形式并存入数据库。这种RAG架构,使得机器人能够超越大模型预训练知识的范畴,提供具有时效性、针对特定领域的准确信息。它确保了机器人在进行医疗相关咨询时,其回答是基于可靠、可溯源的数据,而非模型的凭空“幻觉”,从而极大地提升了机器人的实用价值和可信度。 4.5 总结 “智护夜巡”机器人的语音交互系统,是基于现代化、高可用性技术栈的一次成功实践。它巧妙地将本地CPU优化的faster-whisper用于高精度语音识别,将高效的edge-tts用于提供自然流畅的语音输出,并将一个通过ChromaDB知识库实现检索增强(RAG)的本地化Qwen3-8B大语言模型作为智能核心。整个系统通过稳健的多线程架构和精细的提示工程,保证了出色的用户体验。该方案在保障数据隐私、确保系统稳定性与提升信息准确性方面均表现出色,是开发面向特定应用场景的智能交互机器人的一个优秀范例。 5. 数据库与系统集成 系统集成与数据库管理是确保机器人各功能模块高效协同、稳定运行的基石。通过部署高性能的数据库管理系统(如MySQL)和GPU加速环境,机器人能够实现海量数据的实时存储、高效处理和快速查询。同时,利用GPU强大的并行计算能力对计算密集型任务进行优化,从而确保整个机器人系统的高效性和实时响应速度。

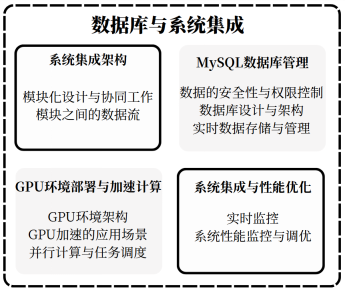

5.1 系统集成架构

图12 数据库与系统集成的概念图 5.1.1 模块化设计与协同工作 本机器人系统采用了先进的模块化架构进行设计。SLAM建图、路径规划、环境感知、语音交互和手臂控制等核心功能模块,均通过标准化的接口实现数据交互与功能调用。中央控制系统(基于ROS框架)作为整个系统的核心协调枢纽,实时处理从各模块汇集而来的数据流,并基于融合信息执行智能决策与任务调度。这种高内聚、低耦合的架构设计,不仅确保了模块间通信的高效与可靠,更通过集中式的管控实现了多系统间的无缝协同,使机器人能够智能、准确、高效地响应复杂任务指令。 5.1.2 模块之间的数据流 在系统内部,各模块的输入与输出数据通过统一的系统总线(ROS通信机制)进行高效传输。例如,红外相机、LIDAR等传感器采集的原始数据流,会实时传递给环境感知模块进行处理;路径规划模块则会依据感知模块输出的障碍物信息和SLAM模块提供的定位信息来生成安全路径;机器人手臂模块根据上层任务指令执行精确的物理操作;而语音交互模块则负责处理用户的语音请求并生成相应的文本或控制指令。 5.2 MySQL数据库管理 MySQL数据库在机器人系统中扮演着数据管理与持久化存储中心的角色,负责统一存储机器人所有模块在运行过程中产生的全部数据。数据库系统的设计目标是确保数据的安全性、完整性和高可用性,以便在机器人长期运行过程中能够有效存储和管理海量的操作数据。 5.2.1 数据库设计与架构 机器人系统采用了高度结构化的数据库设计方案。我们根据功能模块的需求,构建了多维度、关系明确的数据表:定位数据表用于实时记录机器人的精确坐标和历史导航轨迹;任务记录表详细追踪每一项任务的执行状态、起止时间和结果;传感器数据表则用于归档存储来自红外相机、LIDAR等设备的关键原始数据流;语音交互表完整地保存了用户与机器人的对话记录和指令解析结果。为了应对高并发读写,我们通过设计多级索引和引入内存缓存机制来显著提升查询效率,并结合水平分表与时间分区技术,实现了对亿级数据的有效管理,为上层系统的智能决策提供了毫秒级的数据支撑。 5.2.2 实时数据存储与管理 在数据存储策略上,所有传感器数据、机器人状态信息、任务执行记录等都将实时、持久化地存储到MySQL数据库中。通过高效的数据库管理系统,机器人能够保证数据的实时性、完整性以及后续进行复杂查询分析的效率。在数据备份与恢复方面,系统配置了自动化的备份与恢复机制,通过定期对数据库进行全量及增量备份,以防止因意外事件导致的数据丢失,确保了数据的安全与可靠。 5.2.3 数据的安全性与权限控制 数据安全是本系统的重中之重。我们采用了SSL加密技术来保障数据在网络传输过程中的机密性,并通过严格的身份认证机制防止未授权访问。在此基础上,我们还实现了精细化的数据库权限控制,确保只有获得授权的用户或服务才能访问或修改敏感数据,从而保护了用户隐私和系统核心数据。 5.3 GPU环境部署与加速计算 在机器人系统中,深度学习模型推理、实时路径规划、复杂图像处理等功能均涉及大量的浮点运算。为了提升系统的实时响应能力和处理效率,所有计算密集型任务都将通过专用的GPU环境进行加速处理。 5.3.1 GPU环境架构 在机器人的感知与计算单元中,GPU计算发挥着至关重要的作用。我们通过配置NVIDIA Tesla或RTX系列等高性能计算卡,并结合CUDA和cuDNN等专用软件库,构建了强大的并行计算环境。该环境能够显著加速深度学习模型的推理过程、动态路径规划算法的求解以及高分辨率图像的处理等任务。特别是对于机器人感知模块中的实时目标检测和语音识别等神经网络推理任务,我们依托TensorFlow、PyTorch等主流深度学习框架,使其能够充分利用GPU的海量核心进行并行加速,从而满足严苛的实时性要求。 5.3.2 GPU加速的应用场景 GPU加速技术在机器人多个智能计算任务中得到了广泛应用,显著提升了关键模块的运行效率。对于深度学习模型推理,如基于YOLO、Faster R-CNN的目标检测和基于大语言模型的语音识别,GPU的并行计算能力能大幅缩短推理时间,确保实时性能。在运动控制方面,路径规划算法(尤其是动态环境下的实时避障计算)通过GPU加速可优化计算效率,提升响应速度。同时,图像处理与感知任务(包括红外图像增强、特征提取、图像匹配等)以及多传感器数据融合过程,均可受益于GPU的高吞吐量计算,实现更高效的感知决策。 5.3.3 并行计算与任务调度 在并行计算层面,GPU凭借其数以千计的计算核心,能够同时处理多个数据流或计算任务,从而显著加快数据处理和计算密集型算法的执行速度,这对于处理大规模点云数据、高分辨率图像以及大型神经网络模型至关重要。在任务调度层面,我们通过设计合理的任务调度与负载均衡策略,确保机器人系统中的各项计算任务能够被智能、高效地分配到GPU资源上,最大限度地发挥其计算潜能,避免了计算资源的闲置与浪费。 5.4 系统集成与性能优化 5.4.1 模块协同优化 我们将各个功能模块(路径规划、感知、语音交互等)与中央数据库进行了高效集成,确保了各模块之间数据传输与交互的流畅性。利用数据库管理系统对所有数据进行统一汇聚和智能调度,进一步增强了机器人的实时响应能力和决策的全局最优性。 5.4.2 系统性能监控与调优 为了确保系统的长期稳定运行,我们集成了如Prometheus等专业的系统监控工具,用以实时监控机器人的核心性能指标,包括CPU与内存占用、数据库性能(QPS、延迟)、GPU使用率及温度等。基于这些实时监控数据,我们能够动态地进行负载均衡与性能优化,例如根据机器人的当前工作负载和计算需求,智能调度计算资源,确保GPU等宝贵资源的充分利用,从而持续提升系统的整体性能。 5.5 总结 通过深度整合MySQL数据库管理系统和部署GPU硬件加速环境,本项目的机器人系统构建了一个高效、稳健的底层支撑平台。数据库管理系统确保了海量数据的安全性、完整性和实时性,为上层应用提供了可靠的数据基础。而GPU加速环境则显著提升了系统的计算性能,特别是在处理大规模数据和执行深度学习推理任务时,为机器人的智能化和实时性提供了强劲动力。最终,整个系统的精密集成与持续优化,确保了机器人各功能模块能够高效协同与稳定运行,完全能够满足高实时性、高智能化的应用需求。

|

|

五、作品经济指标分析(实用性分析) 一、主要软件平台 / 设备材料清单 (一)软件平台 1. ROS 系统:作为机器人操作系统,主要用于管理和协调硬件设备,其提供的丰富功能包与工具,能有效降低机器人应用开发难度。凭借开源特性,该系统无需支付软件授权费用,结合 ROS 社区内开发者共享的代码和经验,可大幅缩短开发周期,减少重复性开发工作。 2. FAST-LIO 定位算法:专注于激光雷达数据处理,能够实现快速、准确的实时定位。经过实践验证,该算法性能稳定可靠,为机器人在复杂环境中的自主移动提供了核心技术支撑。相较于商业定位算法,采用开源或自主研发的 FAST-LIO 算法,可有效规避高昂的授权费用。 3. conceptgraph 建图算法:主要功能是构建机器人所处环境的高精度地图,帮助机器人更好地感知和理解周围环境。使用该算法能够减少对商业建图软件的依赖,从而降低开发成本。 (二)设备材料 1. NUC 迷你主机:作为机器人的核心计算单元,承担着运行各类算法和处理传感器数据的重任。其具有体积小巧、性能稳定的特点,能够满足机器人实时计算需求,市场价格因配置不同存在差异 。 2. 大功率充电宝:为机器人提供移动电源支持,确保其在无外接电源的情况下仍能持续工作。充电宝的容量和品质直接决定续航时长,本作品选用的型号可满足特定工作场景下的电力需求。 3. MID360 激光雷达:用于获取周围环境的三维空间信息,是实现机器人定位和建图的关键传感器。其精度和扫描范围对机器人性能影响显著,该型号在市场上具备较高的性价比。 4. 奥比中光深度相机:能够补充激光雷达信息,获取更详细的物体表面深度数据,进一步提升机器人的环境感知能力,在同类产品中性能表现优异。 5. 海康相机:主要负责采集视觉图像,为机器人的目标识别、导航等任务提供视觉信息支持。作为安防和工业领域广泛应用的设备,其质量可靠性较高。 6. 机器人底盘:作为机器人的运动载体,需具备一定的负载能力和运动性能,其市场价格因规格和功能不同而有所差异。 二、详细成本测算 (一)硬件成本 将上述设备材料的市场价格进行汇总相加,即可得出硬件总成本。 (二)软件成本 由于 ROS 系统、FAST-LIO 定位算法和 conceptgraph 建图算法均采用开源或自主研发模式,因此无软件授权费用。但在开发过程中,需要投入人力进行算法优化和系统集成等工作,这部分成本包括开发人员的工资、福利以及开发时间成本等。 (三)其他成本 在作品制作过程中,还可能产生一些其他费用,如测试费用、工具购置费用等。综合以上各项成本,作品的总成本为:硬件总成本 + 软件成本(人工成本) + 其他成本。 三、评估作品的经济效益和可行性 (一) 经济效益评估 1.应用领域与市场需求 1) 养老院:随着老龄化程度加剧,养老院对护理机器人的需求日益旺盛。以一线城市为例,假设每台机器人可替代 1 名护理人员的部分工作,护理人员平均月薪约 8,000 元,若机器人使用寿命为 5 年,则每年可节省人力成本:8,000 元 / 月 × 12 月 ÷ 5 年 = 19,200 元 / 年。 2) 医院:在夜间查房、物品递送等工作中,机器人能够有效减轻医护人员负担,提升工作效率。假设每台机器人可分担 1 名护士 1/3 的工作量,护士平均月薪约 12,000 元,则每年可节省人力成本:12,000 元 / 月 × 12 月 ÷ 3 ÷ 5 年 = 9,600 元 / 年。 3) 家庭护理:随着人们生活品质要求的提高,家庭护理机器人市场潜力巨大。假设机器人售价为 10 万元,每年销售 100 台,则可实现销售收入 1,000 万元,扣除成本后利润可观。 2.运营成本与收益 1) 运营成本:主要涵盖设备维护、软件升级、技术支持等费用,预估每年运营成本约为总成本的 10%。 2) 收益:以养老院和医院为主要应用场景,假设机器人售价为 10 万元,每年销售 50 台,则销售收入可达 500 万元,扣除运营成本后可得出净利润。 (二)可行性评估 1. 技术可行性:从设备和软件算法来看,所选用的 NUC 迷你主机、激光雷达、深度相机等均为市场成熟产品,性能能够满足机器人基本需求。ROS 系统以及 FAST-LIO、conceptgraph 等算法在机器人领域已有广泛应用和实践验证,技术实现路径清晰。通过向日葵远程控制以及命令行操作开启各个节点,只要操作人员具备一定的计算机和机器人知识,即可顺利完成操作,技术上具备可行性。 2. 市场可行性:随着工业自动化和智能化的发展,具备自主定位和建图功能的机器人市场需求持续增长。无论是工业生产中的物料搬运、巡检,还是服务领域的清洁、配送等场景,都存在大量潜在需求。本作品若能进一步优化性能,提升稳定性和可靠性,有望在市场中占据一席之地,具备市场可行性。 3. 经济可行性:项目总成本相对较低,硬件成本主要集中在底盘、激光雷达和深度相机等设备上,软件成本因采用开源方案而处于较低水平。同时,项目在养老院和医院等应用场景中,能够显著降低人力成本,提高工作效率,具备较高的经济效益。通过成本测算和经济效益评估可知,若作品在实际应用中能够获得足够收益,覆盖总成本并实现盈利,从经济角度看具有可行性。并且,随着技术进步和生产规模扩大,硬件设备成本有望进一步降低,将进一步提升作品的经济效益和经济可行性。 四、作品推广的经济性分析 (一)市场推广策略 针对养老院、医院和家庭护理三大主要目标市场,需制定差异化推广策略。养老院市场推广应着重强调机器人辅助护理人员工作的优势,如承担重复性、体力消耗大的护理任务,从而降低人力成本,同时提升护理服务质量;医院市场则突出机器人在夜间查房、物品递送等任务中的高效性和精准性,减轻医护人员工作负担;家庭护理市场需聚焦产品的人性化设计和智能化功能,满足家庭用户对高品质生活的追求。 (二)推广渠道 线上推广可充分利用社交媒体、行业论坛、视频平台等渠道,通过发布产品介绍、技术演示视频以及真实用户案例,吸引潜在客户关注;在行业论坛分享产品技术优势和行业见解,提升产品在专业领域的知名度;视频平台的演示视频则以直观的视觉效果和详细讲解,帮助用户深入了解产品功能。线下推广可选择参加国内外知名的机器人展会、医疗设备展会,通过现场实物展示和功能演示,与客户进行面对面深度交流,解答疑问,建立合作沟通渠道。此外,与养老院、医院、医疗器械经销商建立稳固的合作关系,借助其现有渠道和客户资源,将产品推广至更广泛的市场,实现互利共赢。 (三)推广成本 市场调研是推广工作的基础环节,通过全面、深入调研目标市场,了解市场需求、竞争对手情况及行业发展趋势,为推广策略制定提供依据,此过程会产生市场调研费用。营销费用包括制作宣传资料(如产品手册、宣传视频)、参加行业展会(展位租赁、展品运输、人员差旅)、线上推广(网络广告投放、社交媒体推广)等方面的支出。为确保客户能够熟练使用产品,还需提供专业的客户培训服务,培训费用涵盖培训人员工资和培训场地租赁等相关费用。 (四)盈利分析 通过计算每年的销售收入,并扣除推广成本和产品生产成本(假设生产成本在后续生产中保持稳定或因规模效应降低),可预测作品推广后的盈利情况。若在一定时间内累计盈利为正,且达到预期目标,则说明作品推广具有经济性。同时,通过分析盈利平衡点(即销售收入刚好覆盖所有成本时的销售量),可为推广策略提供参考。若在预计推广时间内能够快速达到盈利平衡点并实现盈利增长,则表明作品推广的经济性良好。 综上所述,本项目的智能护理机器人具有较高的市场应用潜力,特别是在老龄化社会的背景下,养老院、医院和家庭护理市场需求巨大。技术上,采用的SLAM、红外感知、语音交互等技术已经得到广泛应用,系统架构成熟,具有较强的可行性。借助GPU加速和MySQL数据库等技术,能够实现高效的数据管理与计算,保证机器人在动态环境中的实时响应能力。经济上,随着人工智能与机器人技术的发展,智能护理机器人成本逐渐降低,市场接受度提高。长期来看,智能护理机器人能够显著降低人力成本,提高护理效率,特别是在老年人日常护理和夜间查房等高频任务中的应用。通过智能化的护理服务,减少医护人员的工作负担,并提高老年人的生活质量,市场前景广阔,具备商业化和推广应用的可行性。 |

|

六、作品制约因素分析 本项目在设计与研发“智护夜巡机器人”的过程中,充分并综合地考虑了技术之外的社会、健康、安全、法律、标准及文化等多维度的制约因素,并恪守工程师的职业道德要求,确保项目的可行性与社会价值。 1. 社会、健康与安全因素 社会层面:本项目旨在应对全球老龄化加剧与专业护理人员短缺的社会挑战 。通过提升终端用能的电气化与智能化水平,机器人旨在减轻医护人员,特别是夜间值班人员的工作负担 ,为构建可持续的养老护理体系提供一种有效的技术方案。 健康层面:作为一款护理机器人,用户的健康是设计的核心。机器人不仅能辅助完成送药、递物等物理任务 ,还能通过红外感知技术在不打扰用户休息的情况下进行生命体征的初步观察(如体温感知、在床状态监测) ,这对于保障老年用户夜间的健康与安全至关重要。 安全层面:我们从物理、数据和伦理三个维度构建了全面的安全保障体系。 物理安全:为确保机器人在低光或无光的夜间环境中安全运行,系统融合了红外相机与激光雷达(LIDAR)进行环境感知 。采用A算法进行全局路径规划,并结合人工势场法进行实时的动态避障 ,以应对人员走动等突发情况。同时,机械臂采用PID控制算法,确保其在执行扶持、递物等任务时动作平稳、力度可控,避免对用户造成任何物理伤害 。 数据安全:系统采集的所有敏感数据(如位置、感知信息、语音记录)均存储于MySQL数据库中 。我们计划采用SSL加密传输和严格的数据库权限控制,确保只有授权人员才能访问用户数据,保障用户隐私 。 伦理安全:我们认识到,对老年用户的监护必须以尊重和信任为前提。因此,项目在未来应用中将严格遵守“知情同意”原则,明确告知用户机器人将采集何种数据、作何用途。同时,将建立清晰的应急响应机制,当机器人检测到异常情况时,会第一时间通知人工护理员进行干预,确保决策权始终在人的手中。 2. 法律与标准因素 法律合规性:本项目的研发充分考虑了相关法律法规的要求。在数据处理方面,系统的设计将严格遵守《中华人民共和国个人信息保护法》等数据安全法规,确保用户数据的采集、存储和使用合法合规。此外,考虑到护理机器人的功能属性,其设计理念在安全性、可靠性方面积极参考未来可能适用的医疗器械相关法规,为产品的长远发展奠定合规基础。 遵循行业标准:为保证作品的专业性和可靠性,我们的设计参考了相关行业标准。在安全设计上,我们借鉴了 ISO 13482(个人护理机器人安全标准)等国际标准的核心理念,如本质安全设计和安全防护。在技术架构上,我们选用ROS(机器人操作系统)、TensorFlow、PyTorch等在行业内被广泛应用的开源平台与框架 ,这不仅保证了技术的稳定性和前沿性,也遵循了行业“事实标准”,便于未来系统的维护、扩展与集成。 3. 文化因素 不同文化背景下,社会对护理机器人的接受度存在差异。为提升机器人的亲和力与用户接受度,本项目在人机交互设计上着重考虑了文化适应性。系统集成了基于大语言模型(如GPT)的智能对话功能 ,能够进行自然流畅、富有情感的交流,而不仅仅是执行机械指令 。通过Google TTS等语音合成技术,可以对机器人的语速、音调进行个性化调整 ,使其能够更好地适应不同用户的语言习惯和文化偏好,提供更加人性化的陪伴与关怀。 4. 他人知识产权的使用与处理及工程师职业道德 知识产权处理:我们明确认知到,本作品是建立在众多优秀的前人成果之上的。项目使用了包括ROS、YOLO、Faster R-CNN、Kaldi等开源软件,以及Google Speech-to-Text、GPT模型等第三方技术或服务 。我们承诺将严格遵守各项技术的开源许可协议(如MIT、Apache 2.0等)和服务条款(Terms of Service),在使用过程中明确标注引用,并以符合其规定的方式进行集成开发。 原创性贡献:本项目的创新性不在于发明上述底层算法,而在于将这些先进技术进行创新性地集成与应用,以解决特定场景下的复杂工程问题。我们的核心贡献在于:1)提出了融合红外感知与SLAM的低光环境导航方案 ;2)构建了集成大语言模型、能进行情感支持的语音交互系统 ;3)设计并整合了一套面向夜间自主查房、动态避障、安全交互和数据管理的完整护理机器人技术方案 。 |

|

七、作品创新性与先进性(创新性分析) 本项目的创新性体现在多个方面,特别是如何将现代先进的技术应用于智能护理领域,解决老年护理中面临的多项复杂问题。 1. 多功能集成:本项目通过将路径规划、环境感知、语音交互、与目标检测等多个功能模块有效集成,为老年人提供了全方位的护理支持。机器人能够自主导航执行夜间查房、障碍物避让、语音互动以及物理辅助等多种任务,大大提升了护理效率,减少了医护人员的工作负担。 2. 低光环境下的感知能力:通过结合红外相机和激光雷达(LIDAR),机器人能够在低光环境中实现高效的目标检测与障碍物识别。这种结合多传感器的数据融合方法,使得机器人能够在复杂、动态的环境中精准感知人体、障碍物和其他热源,尤其在夜间查房时为老年人提供安全保障。 3. 智能语音交互:本项目的语音交互系统采用了高度本地化、高性能的技术组合,实现了高效的语音识别、自然语言理解和语音合成能力。语音识别选用 faster_whisper 库的 large-v3 模型,通过 int8 量化在 CPU 上高效运行,支持粤语、普通话和英语识别,特别优化了在噪声环境和不同口音下的表现;语音合成采用 edge-tts 库,利用 Microsoft Edge 云端服务生成自然流畅、富有情感的语音回复;核心对话能力基于本地化部署的 Qwen/Qwen3-8B 大语言模型,结合 ChromaDB 向量数据库构建的医疗护理知识库,通过检索增强生成(RAG)架构显著提升了回答的专业性和准确性。 4. 实时数据管理与GPU加速计算:所有功能模块的数据通过MySQL数据库进行集中存储与管理,确保数据的高效访问与安全性。同时,系统利用GPU加速进行深度学习模型的推理与路径规划算法的计算,显著提高了系统的实时响应能力和计算效率,确保机器人能够在动态环境中快速作出决策并执行任务。 5. 复杂工程问题的解决:项目在实现过程中解决了多个复杂的工程问题,包括多传感器数据融合、实时路径规划、动态避障、高效的语音识别与合成、机器人控制系统的精确调度等。这些问题的解决要求系统具备高效的计算资源调度能力、精准的传感器数据处理能力以及稳定的硬件与软件协同能力。

本项目的创新性不仅体现在各项前沿技术的集成应用,还在于其解决了当前老年护理领域中的关键难题,提升了护理效率、增强了老年人的生活质量,同时减少了医护人员的工作压力,具有广泛的应用前景和社会价值。

|